Спецпроекты

Татар-информ

©2023 ИА «Татар-информ»

Учредитель АО «Татмедиа»

Новости Татарстана и Казани

420066, Республика Татарстан, г. Казань, ул. Декабристов, д. 2

+7 843 222 0 999

info@tatar-inform.ru

«Сначала знания были в головах старцев»: в Иннополисе обсудили, когда ИИ станет обыденным

Сколько стоит запуск собственного ChatGPT? Чем грозит человечеству дальнейшее развитие искусственного интеллекта? Каковы правила этикета для пользователей нейросетей? Ответы на эти вопросы прозвучали сегодня на Международной конференции AI IN 2023 в Иннополисе. Подробности – в репортаже «Татар-информа».

Сколько стоит ChatGPT «построить»?

Первый день конференции стартовал сегодня с пленарного заседания. На нем российские и зарубежные эксперты в области искусственного интеллекта обсудили ключевые вопросы, касающиеся этой технологии. Среди них текущий уровень развития и внедрения, польза или угроза для человечества, а также финансы и этика.

О ситуации в России подробно рассказал директор по направлению «Цифровая трансформация отраслей» АНО «Цифровая экономика» Алексей Сидорюк. Ключевые финансовые показатели таковы:

- общий объем рынка ИИ в России – 650 млрд рублей;

- финансирование федерального проекта «Искусственный интеллект» в 2021-2024 годах составляет 28,3 млрд рублей;

- на финансирование и внедрение ИИ-стартапов было выделено 3,6 млрд рублей;

- внедрение ИИ в ключевых отраслях экономики до 2025 года может дать 1-2% роста ВВП страны.

Алексей Сидорюк: «Создание «собственного ChatGPT» в объемах финансирования обойдется в 60 млн долларов плюс много месяцев обсчета этой модели»

Фото: © Салават Камалетдинов / «Татар-информ»

«Мы не отстаем от мировой гонки по разработке генеративных нейросетей, поскольку создаются отечественные решения. Лидеры этой области в России — Сбер и Яндекс с их «Гигачатом», «Кандинским», «Шедеврумом» и «Яндекс GPT», а также МТС с собственной платформой генерации кода и другие участники. К слову, создание собственного ChatGPT в объемах финансирования обойдется в 60 млн долларов плюс много месяцев обсчета этой модели. Но у нас в любом случае должно быть несколько крупных инфраструктурных решений», – считает Сидорюк.

По уровню внедрения Россия все же несколько отстает от общемирового. Но, как отметил спикер, один из приоритетов новой национальной стратегии России как раз заключается в активном внедрении ИИ в отрасли экономики в государственном контуре.

«Нейросети не заменят процесс обучения – они помогут людям обучаться намного быстрее и глубже»

С основными трендами в области ИИ участников мероприятия познакомил директор по развитию технологий искусственного интеллекта Яндекса Александр Крайнов. Прежде всего, он акцентировал внимание на генеративных моделях. Этот тренд был порожден компанией Open AI и ее продуктом ChatGPT.

«Он просто все перевернул! Генерация картинок, распознавание или синтез речи – все это сейчас отходит на второй план по сравнению с тем, что происходит в анализе текста, – констатировал эксперт. – В чем революция? В прошлом году большие генеративные сети не поражали нас тем, насколько умно они отвечали и решали задачи. Но была сделана одна значительная «добавка»: модели были доучены на общении с людьми. Это дало сумасшедший результат».

Александр Крайнов: «Мы загрузили в модель точное, конкретное знание и при этом не сняли с нее требования по поиску закономерностей»

Фото: © Салават Камалетдинов / «Татар-информ»

По словам Крайнова, вся история машинного обучения – это борьба с запоминанием. В машинном обучении всегда действовала установка: если модель что-то помнит, то ты, как специалист по машинному обучению, сделал ошибку. Модель должна выводить закономерности, а не запоминать. Запоминание было дурным тоном.

«Но мы загрузили в модель точное, конкретное знание и при этом не сняли с нее требования по поиску закономерностей. Возможно, для человечества это следующий большой этап переноса знаний. Сначала мы хранили знания в головах старцев, потом появилась наскальная роспись, затем – книгопечатание, после этого – интернет, а сейчас мы перемещаем знания в нейронные сети», – описал ситуацию эксперт из Яндекса.

Романа Шайхутдинова интересовало, не произойдет ли ослабления новых поколений из-за развития ИИ

Фото: © Салават Камалетдинов / «Татар-информ»

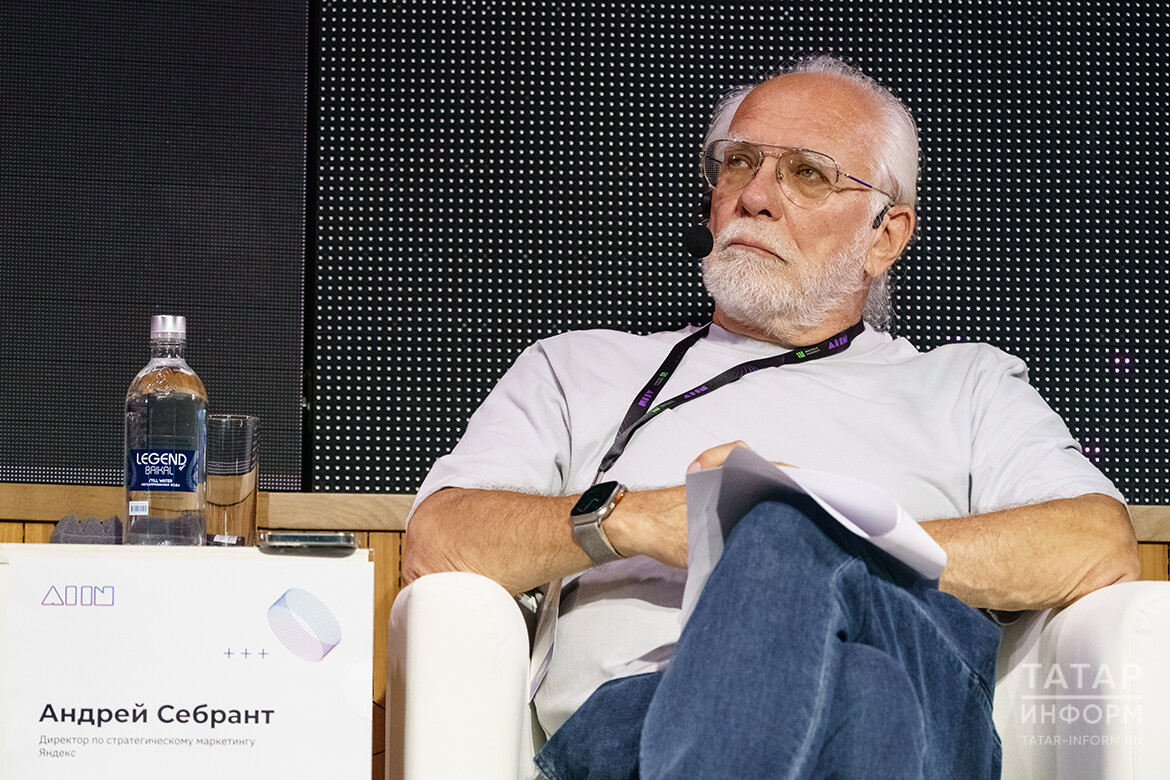

На эту тему возникла небольшая дискуссия, инициированная вице-премьером РТ Романом Шайхутдиновым. Его интересовало, не произойдет ли ослабления новых поколений из-за развития ИИ. На его вопрос ответил кандидат физико-математических наук, директор по маркетингу сервисов Яндекса Андрей Себрант: «На мой взгляд, все новые инструменты усиливают обучающихся. Нейросети не заменят процесс обучения – они помогут людям обучаться намного быстрее и глубже».

«Еще один тренд заключается в том, что ИИ впервые становится рабочим инструментом индивидуального пользования. К чему это приведет? Мы встретимся здесь через год и увидим, что произойдет полная десакрализация. То есть ИИ перестанет рассматриваться как что-то необычное. Будет то же самое, что когда-то произошло с компьютером», — резюмировал свое выступление Александр Крайнов.

Андрей Себрант: «Нейросети помогут людям обучаться намного быстрее и глубже»

Фото: © Салават Камалетдинов / «Татар-информ»

Ждем наступления эпохи трансгуманизма и технологической сингулярности

Участники встречи также не обошли стороной тему рисков, связанных с распространением технологий в мире.

«На мой взгляд, квинтэссенцией реализации технологии ИИ будет внедрение принципов теории трансгуманизма и технологической сингулярности. Это – возможный результат технологического развития человечества, но в этом есть большая опасность: отсутствие естественного отбора, евгеника и в конечном счете прекращение развития естественных особенностей человека», – поделился своими опасениями Роман Шайхутдинов.

В свою очередь ректор Университета Иннополис Александр Тормасов в качестве финального аккорда встречи поднял вопрос этики в работе с искусственным интеллектом. Он напомнил, что в случае с ИИ четко сформулированы правила поведения для разработчиков: 193 страны оставили свои подписи под Соглашением об Этике искусственного интеллекта, созданным под эгидой ООН.

Александр Тормасов: «Университет Иннополис предлагает свое видение и рекомендации пользователю решений на основе искусственного интеллекта»

Фото: © Салават Камалетдинов / «Татар-информ»

«В то же время наше поведение, как пользователей ИИ-систем, бесконтрольно. Мы часто заигрываем с решениями на основе ИИ, случайно или осознанно наполняя его негативным содержанием, не задумываясь над последствиями наших действий, — отметил Тормасов. — Университет Иннополис предлагает свое видение и рекомендации пользователю решений на основе искусственного интеллекта, и я готов их перечислить».

- Я верю, что разработчики стараются создать максимально безопасные системы ИИ, и чем точнее я следую их рекомендациям, тем защищеннее себя чувствую.

- Я сознаю, что ответ ИИ-системы может меня не устроить: я мог ввести некорректный запрос или не понять ответ. Разработчики не несут за это ответственности.

- Мое взаимодействие с ИИ-системами — это взаимодействие с людьми, которые их создали / оставили там свои данные.

- Работая в ИИ-системах, я не допускаю унижения других людей в отношении их расы, возраста, пола, состояния здоровья, отношения к религии.

- Я понимаю, что вопреки усилиям разработчиков иногда информация в ИИ-системе может быть некорректной или устаревшей.

- Если системы ИИ в чем-то противоречат моим культурным убеждениям, я не рассматриваю это как намеренное оскорбление.

Как сообщил ректор Университета Иннополис, сегодня планируется подписание этого «кодекса» сразу несколькими компаниями – участницами конференции.

Следите за самым важным в Telegram-канале «Татар-информ. Главное», а также читайте нас в «Дзен»